O coeficiente kappa, simbolizado pela letra grega minúscula κ e criado pelo estatístico Jacob Cohen (1960), mede a concordância entre dois avaliadores, cada um classificando N itens em C categorias mutuamente exclusivas.

Em outras palavras, é uma medida quantitativa de confiabilidade para dois avaliadores que estão julgando a mesma coisa, corrigida pela frequência com que os avaliadores podem concordar por acaso.

A equação usada para calcular o Kappa é:

Onde: Pr (α) representa a concordância observada real, e Pr (e) representa concordância por acaso.

Existem outros coeficientes Kappa?

O Kappa de Cohen é o mais usado e avalia a concordância entre dois examinadores (ou dois métodos). Por outro lado, Fleiss (1981) propôs uma extensão do Kappa para o caso em que há mais de dois examinadores (ou métodos), que foi denominada Kappa Generalizado ou Kappa de Fleiss.

Outra extensão do Kappa com grande aplicabilidade é o Kappa Ponderado, que visa distinguir as discordâncias/concordâncias atribuindo pesos diferentes para cada tipo (por exemplo, em leves, moderadas e graves).

Bem, mas agora, vamos aprender a calcular o Kappa de Cohen (para dois avaliadores).

Como calcular o coeficiente Kappa no SPSS?

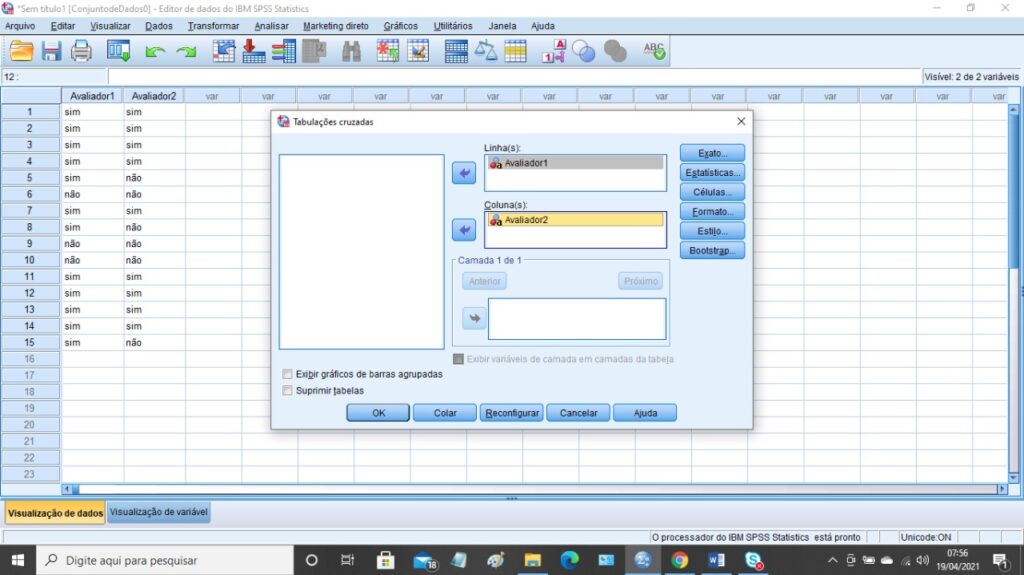

Para calcular o Coeficiente Kappa de Cohen no SPSS clique em Analisar –> Estatísticas Descritivas –> Tabela de referência cruzada.

Posteriormente, transfere um avaliador ao quadro “Linha(s)” e o outro avaliador ao quadro “Coluna(s)” (a ordem de colocação dos avaliadores é irrelevante).

Agora, marque a opção “Kappa” da aba “Estatísticas”.

Finalmente, nos resultados, a tabela “Medidas Simétricas” proporcionara o valor de Kappa de Cohen e a sua significância.

Como interpretar o coeficiente Kappa?

Teoricamente, o valor máximo de Kappa pode ser 1 quando ambos os juízes tomam a mesma decisão para todos os itens. A seguinte tabela nos proporciona índices e concordância para cada valor de Kappa segundo MacHugh (2012):

Considerando este valores, qualquer Kappa abaixo de 0,60 indica concordância inadequada entre os avaliadores. Um kappa negativo representa concordância pior do que o esperado, ou desacordo.

Gostou desse conteúdo? Precisa aprender Análise de dados? Faça parte da Psicometria Online Academy: a maior formação de pesquisadores quantitativos da América Latina. Conheça toda nossa estrutura aqui e nunca mais passe trabalho sozinho(a).

Referências

Cohen, J. A. (1960). Coefficient of agreement for nominal scales. Journal of Educational and Measurement, 20(1), 37–46. https://doi.org/10.1177/001316446002000104

Fleiss, J. L. (1981). Statistical methods for rates and proportions. John Wiley.

McHugh, M. L. (2012). Interrater reliability: The kappa statistic. Biochemia Medica, 22(3), 276–282.

Como citar este post

Damásio, B. (2021, 11 de maio). Coeficiente kappa de Cohen. Blog Psicometria Online. https://www.blog.psicometriaonline.com.br/kappa-de-cohen/

Respostas de 2